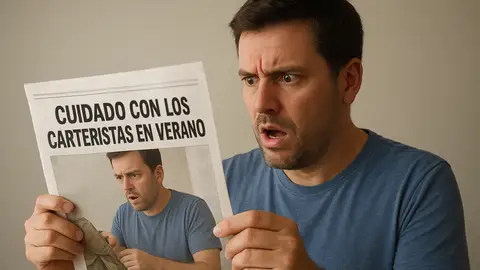

Lo que hasta hace poco parecía un argumento de ciencia ficción ya empieza a convertirse en un problema real. La inteligencia artificial, capaz de crear imágenes hiperrealistas en cuestión de segundos, puede generar situaciones tan sorprendentes como inquietantes: que una persona corriente se vea reflejada en la portada de un periódico o en un post viral de redes sociales, sin haber participado jamás en los hechos narrados.

Un conflicto fortuito donde una imagen podría parecer robada

Imaginemos una noticia o una publicación en redes de una persona donde se que quiere ilustrar una noticia sobre un hecho conflictivo como un robo, una denuncia.. El creador, en lugar de buscar una fotografía de archivo, pide a una IA que genere una imagen de "un persona" cometiendo ese acto. En segundos, aparece un retrato hiperrealista de un hombre con pasamontañas, entrando en una tienda.

Todo parece correcto… hasta que un lector ve la imagen y exclama: "¡Ese soy yo!".

Aunque la coincidencia haya sido totalmente fortuita, el daño a la reputación de esa persona podría ser enorme. Y lo más importante: en España, la ley le daría la razón.

El derecho a la propia imagen, por encima de la IA

El artículo 18 de la Constitución Española y la Ley Orgánica 1/1982 protegen el honor y la propia imagen. Esto significa que cualquier persona que se vea identificada en una publicación dañina, aunque se trate de un retrato ficticio, tiene derecho a reclamar.

En otras palabras: la inteligencia artificial no es un "escudo legal" para los medios, sitios web o personas. El hecho de que la ilustración sea inventada no elimina la posible vulneración de derechos. La responsabilidad siempre recae en el usuario que difunde la imagen, es decir, el periódico, la revista o el creador de contenido.

¿La IA copia caras reales?

Una duda frecuente es si estas imágenes generadas provienen de fotos reales. La respuesta es no.

Los modelos de IA se entrenan con millones de ejemplos visuales y aprenden patrones estadísticos de cómo son los rostros, objetos o escenarios. A partir de ahí, crean imágenes nuevas desde cero.

Sin embargo, la combinación de rasgos puede dar lugar a un parecido razonable con personas existentes, especialmente si se trata de estilos hiperrealistas. No es copia, pero sí puede ser una coincidencia peligrosa.

Casos que adelantan este problema

Aunque todavía no hay en España un caso exactamente igual, sí existen precedentes que muestran el camino:

- El caso de Almendralejo (2023): un grupo de adolescentes creó deepfakes sexuales de compañeras de clase. Aunque las fotos eran sintéticas, las chicas eran perfectamente reconocibles. La Fiscalía abrió investigación por un posible delito contra la intimidad.

- Scarlett Johansson vs. la IA (2023, EE. UU.): la actriz demandó a una aplicación que usó su rostro generado por IA en un anuncio sin permiso.

- Sentencias del Tribunal Europeo de Derechos Humanos: el TEDH ha señalado en varias ocasiones que incluso caricaturas o montajes pueden vulnerar la reputación de una persona si la hacen reconocible.

Estos casos apuntan a una misma conclusión: aunque la imagen no sea "real", el perjuicio sí lo es.

Cómo se puede evitar este problema

No existe una verificación automática que garantice al 100% que una cara inventada no se parezca a alguien real. Por eso, los expertos recomiendan:

- Usar imágenes de IA en contextos no sensibles.

- Evitar retratos hiperrealistas en noticias sobre crímenes, juicios o polémicas.

- Incluir siempre una etiqueta clara: "Imagen generada por IA, no corresponde a ninguna persona real".

- Optar por estilos ilustrativos o simbólicos, en lugar de fotográficos.

La Unión Europea ya prepara un marco legal más estricto. La nueva AI Act, que entrará en vigor progresivamente, obligará a que todo contenido generado por IA esté claramente etiquetado. Además, exigirá a las plataformas responsables filtros para minimizar riesgos de suplantación o difamación.

Conclusión

Lo que parecía ciencia ficción se ha convertido en un dilema jurídico muy real. Una simple ilustración de IA podría arruinar la reputación de alguien inocente. La inteligencia artificial no tiene intencionalidad ni responsabilidad, pero los humanos que la usan sí.

En el fondo, la cuestión no es si la IA puede inventar caras, sino si nosotros estamos preparados para asumir que cualquier imagen, por ficticia que sea, puede tener consecuencias reales.